基于视觉感知的 eVTOL 避障系统设计

基于视觉感知的 eVTOL 避障系统设计

通 过 研 究 电 动 垂 直 起 降(Electric Vertical Takeoff andLanding,eVTOL)飞行器的发展,结合自主避障技术的重要性,针对 eVTOL 飞行器在低空域飞行时的复杂环境问题,提出了一套基于视觉感知技术的实时避障系统设计方案,详细阐述了避障系统的框架结构,系统的分析了 eVTOL 飞行器的完整避障过程,旨在为研究提高 eVTOL 飞行器自动驾驶过程中的飞行安全提供一种新的设计思路。

eVTOL 飞行器(后文中将简称 eVTOL)最早是因为空中巴士概念的提出而被得到关注,由于其轻便灵活、节能环保、经济性较好的特点,不仅在军用领域备受重视,民用领域也正在加快推进相关产业的发展。韩国和日本等国家已经开始将城市空中交通(UAM)产业提升到国家层面,作为服务于 UAM 的交通载具,未来 eVTOL 将会逐步应用于城市间的短途交通运输。飞行器在城市环境中飞行时,一些高层楼宇和建筑物将不可避免的对飞行过程产生影响,这就需要考虑城市低空域这种复杂场景下的飞行安全问题。对比民航领域的传统飞机运输,保障飞行安全是最为重要的一点,尤其是载人飞行,一旦发生安全事故,不仅造成人员伤亡,还会造成较大的经济损失。如何更好的保障 eVTOL 的飞行安全是一个必须重视的问题,加上 eVTOL 可以载人飞行的特点,飞行器在系统设计上需要考虑乘客安全,除了通过保障飞行器结构的可靠性外,飞行器是否具备避障功能也是决定安全性的关键因素,通过优化避障系统设计可以更好的保证飞行器乘客的人身和财产安全,因此,针对 eVTOL 的避障系统研究和设计显得至关重要。

现阶段涉及 eVTOL 的技术研究还相对较少,重点集中在研究飞行器的飞行性能和交通管制方面。本文从提升飞行安全的角度上提出了一种将视觉感知技术引入 eVTOL 避障系统的设计方案,希望通过这种设计可以为 eVTOL 未来发展提供一种新的思维方式。因此,本文设计的视觉自主避障技术主要通过深度相机进行视觉感知的方式,感知城市高层建筑等障碍物,系统实时监测 eVTOL 的周围环境,由机载计算机引导飞行器自主躲避障碍物,实现飞行器在没有机载飞行员操纵的情况下可以通过自主避障系统保障飞行安全。

eVTOL 避障系统整体架构

视觉自主避障系统的必要性与组成部分

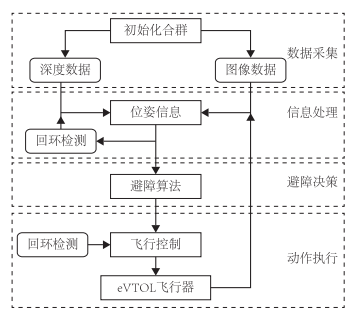

传统的民航飞机主要通过 TCAS(空中交通警戒与防撞系统)和 EGPWS(地面迫近警告系统)两个系统相互配合实现避障。前者针对的是其他飞机,由自身飞机发送询问信号,其他飞机检测到信号后反馈应答信号,再通过机载计算机进行数据计算得出相对位置信息,但是 TCAS 的配套设备复杂,维护费用高,没有经济性优势,只能给出警告信息,需要飞行员配合执行;后者将飞机的飞行数据与提前导入机载计算机的地形数据进行比较,为飞行员提供警告提示,缺点是环境地图无法实时更新,不能满足城市低空域存在建筑楼宇等障碍物时执行避障动作所需的精度要求。目前,eVTOL 通过地面站进行指挥调度中心,通常采用配备远程机长的方式或者自动驾驶的方式控制飞行器,搭载自主避障系统后可以有效减少人员配备,有助于提升复杂环境下的自动驾驶可靠度,为更好的实现完全自动驾驶提供安全保障。综合考虑 eVTOL 的城市飞行环境,设计一套适用于eVTOL 这种特殊飞行器的自主避障系统是必不可少的,并且在系统设计还需要结合一定的经济性和便捷性,满足实时性和飞行器在未知环境中的自主决策要求,在执行避障指令的过程中尽量保证飞行平滑性,以保障载人飞行时的安全和舒适度。而且通过视觉感知技术实现避障的方式能实现先进算法与研究成果的工程应用,对 eVTOL 避障等相关技术的发展也具有一定的价值意义。这种视觉避障系统整体可以分为四大部分,包括数据采集、信息处理、避障决策、动作执行,具体的框架机构如图 1 所示。

图 1 eVTOL 避障系统整体框架示意图

数据采集阶段的核心是 RGB-D 深度相机,这也是视觉感知技术得以应用的重要前提。随着传感器制造工艺水平的不断提升,摄像机的功能变得多元化,依托于摄像机硬件的视觉感知技术也得到了更多的研究机会。有研究者通过深度相机实现了自主移动机器人在三维空间中的实时定位与地图构建,并通过 RGB-D 相机的发展历程和对比单目相机的不足,进一步突出了深度相机精度高、数据处理快的特点。RGB-D 深度相机可以自主发送脉冲光或者红外光,在接收到返回信号后计算出与检测物体的距离信息,再结合图像数据生成深度图。这种能直接获取深度数据和图像数据的特点与避障任务的快速性和实时性要求相契合,不仅降低程序计算量,也提升了反应速度,加上其本身具备较高的可靠性,可以用作 eVTOL 避障系统的输入单元,负责图像和深度数据的采集任务,为视觉感知障碍物提供基础数据信息。

信息处理阶段主要是将采集到的图像数据和深度数据进行数据计算和处理,从而获得 eVTOL 相对于环境的自身位姿信息,判断视觉感知到的是否是障碍物,同时对比飞行器的飞行数据,监测航线信息,保证飞行器最终抵达目的地。2020年王霞等人在其发表的文章中就目前视觉 SLAM 的相关技术发展进行了研究,通过对比分析详细阐述了 SLAM 在不同度量地图下使用的特点。SLAM 框架系统一般分前端和与后端两部分,前端负责处理数据信息,得到飞行器自身位姿,但是随着时间的推移,只依靠前端部分的结果将不可避免的产生迭代误差,这就需要后端部分通过回环检测等方式对误差进行校正,这种循环能保证误差精度。通过视觉 SLAM 框架结合深度数据的信息处理方式可以解决 eVTOL 在避障过程中的实时定位问题,获得的位姿信息将是执行避障决策的前提。

避障决策是 eVTOL 实现避障功能的核心环节,在飞行器自主飞行的过程中,机载计算机需要实时监测外部环境,通过避障决策算法判断是否存在障碍物,如果存在则重新规划飞行器飞行线路,实现避障任务。目前已经研究出多种避障决策所需的路径规划的算法,比较经典和常用的主要是人工势场法、蚁群算法和 A-Star 算法等。但是人工势场法存在容易陷入局部极小点的缺点;蚁群算法属于全局避障算法,不能较好的适用在环境障碍物未知和实时性要求较高的任务环境中;结合国内外对 A-star 算法在路径规划和导航方面的研究,可以看出这种算法具备较好的实时性,能在计算量较小的情况下,快速规划目标路径,适合在未知环境中完成飞行器的避障路径决策。考虑到 eVTOL 载人飞行的特点,在算法优化阶段应当尽量设定一个合理的安全阈值,平滑避障决策路径,保证避障过程的平稳性和安全性,最终通过机载计算机,将避障决策指令与避障路线传送给动作执行模块。

动作执行阶段主要对接 eVTOL 的飞行控制系统,计算机在接收到避障指令时会将飞行器稳定在一定的安全速度范围内,避免因速度和惯性等问题造成飞行器上的人员伤害。由于避障决策阶段已经规划了避障路线,计算机只需要将对应的动作指令发送给飞行器自带的飞行控制系统,正常执行动作指令即可。当 eVTOL 在执行完避障任务,回到安全线路上时,计算机会将当前的飞行数据与原始飞行任务及飞行航线进行对比,继续向目的地飞行,通过与信息处理环节的数据交互达到系统闭环。

核心避障功能的具体过程

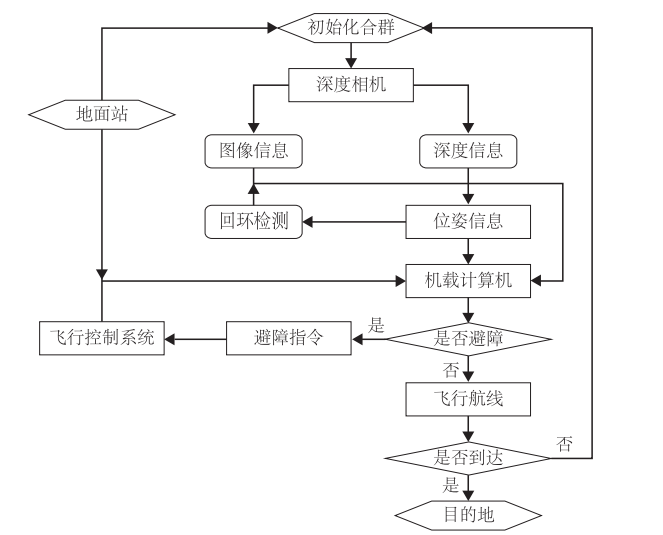

本文研究的 eVTOL 视觉自主避障功能的实现能在满足经济性和可靠性的前提下,较好的提升飞行安全系数,对eVTOL 的未来发展有一定的促进作用。具体的避障过程主要通过监测系统的判断和飞行控制系统的执行来实现,对应的流程如图 2 所示。eVTOL 的地面站将制定好的初始航线信息发送到机载计算机后飞行器启动,同时机载系统开始通过输入采集设备同步监测飞行器周围环境,RGB-D 深度相机采集到的数据会与飞行器当前的位姿信息进行融合处理,以此判断飞行器当前的实际飞行状态,这一部分主要在 SLAM 算法框架下实现,最终的数据结果将用来判断飞行器前方是否存在障碍物。如果有障碍物飞行器将提前做减速飞行,并在相对距离小于设定的避障距离后执行对应的避障决策指令,通过 A-Star算法生成的避障路线将传送给飞行控制系统进行执行动作,整个避障执行的过程将保持一个较慢的飞行速度,必要时可以进行短时间悬停,以保障飞行器内人员的安全。避障任务完成后不可避免的会偏离初始航线,此时飞行器的地理位置信息和飞行数据将通过机载计算机与目的地信息匹配,再结合初始航线数据,重新规划航线飞往目的地,整个监测过程不断循环,直到飞行器到达目标地点结束。

图 2 eVTOL 避障环节流程图

结束语

随着城市空中交通产业的不断发展,eVTOL 未来将具备较大的发展空间,针对其避障技术的研究也将得到更多的关注,本文提出的这套 eVTOL 的视觉实时避障系统设计方案,可以实现机器视觉在感知障碍物过程中的应用,视觉感知技术主要依托于 RGB-D 深度相机和 SLAM 算法框架,结合对 A-Star 避障算法的优化可以进一步降低数据计算量,满足较好的实时性要求,同时结合避障路径规划算法能保障飞行器安全的完成飞行任务。最终通过这种与传统避障形式不同的设计方案,为后续进一步优化 eVTOL 避障系统奠定基础,并提供了一种新的避障设计思路。